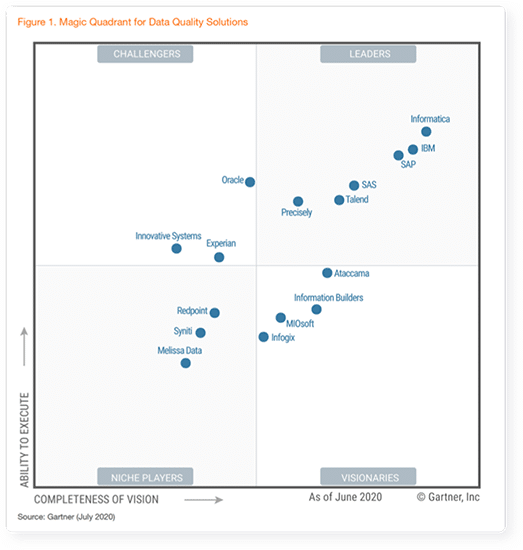

« Toute organisation, quelle que soit sa taille, a besoin de qualité des données », affirme Gartner dans son nouveau Magic Quadrant 2020 pour les solutions de qualité des données. Et pourtant, avec des données de plus en plus surabondantes et multiformes, il devient difficile de mettre fin au chaos et de reprendre le contrôle avec des données fiables. Les données viennent de partout, souvent incomplètes et/ou inexactes, et polluent en silence les pipelines de données. Non seulement ceci complexifie le travail des professionnels de la donnée mais les empêche de prendre les initiatives nécessaires afin de répondre pleinement aux attentes du business. Le point de vue et la solution technologique proposée par Jean-Michel Franco, Senior Director, Product Marketing chez Talend.

Alors même que nous aspirons tous à transformer nos organisations avec le numérique, faisons-nous vraiment confiance à nos données ? Un récent sondage réalisé par Opinion Matters pour Talend indique le contraire : seulement 31 % des professionnels de la donnée ont confiance dans la capacité de leurs organisations à fournir des données fiables en temps voulu.

Les cas d’usage sont légion où l’absence de données fiables se traduit en coût opérationnels, en manque de contrôle des risques, ou en opportunités manquées. Que vous cherchiez à mieux répondre aux besoins de vos clients, à partager une vue à 360 de vos produits ou services, à fluidifier votre supply chain, ou à vous conformer aux dernières contraintes réglementaires, la qualité des données est un facteur clé de succès qui fait la différence entre la réussite et l’échec de vos usages de la data.

Pas de transformation numérique possible sans qualité des données

La qualité des données peut avoir un impact considérable sur les résultats d’une entreprise. Dans ce Magic Quadrant , Gartner a mené une enquête client qui montre que « les entreprises estiment le coût moyen d’une mauvaise qualité des données à 11 millions d’euros par an ». D’autres enquêtes Gartner abondent dans le même sens, positionnant la qualité des données comme le principal challenge des initiatives de data management.

Maintenant que la qualité des données n’est plus considérée comme une activité périphérique mais plutôt comme essentielle à la transformation numérique, nous sommes très fiers que Talend soit reconnu par Gartner comme un leader dans la dernière édition du Magic Quadrant pour les solutions de qualité des données, et ce pour la troisième fois consécutive.

Dans l’intitulé de son Magic Quadrant, Gartner a du reste remplacé « outils » par « solutions », ceci afin de souligner que les bonnes pratiques en termes de qualité nécessitent plus que de simples outils : il convient notamment d’intégrer des workflows, de l’apprentissage par du machine learning, de la collaboration, de la découverte et analyse de données, de l’automatisation etc. De plus, la qualité doit pouvoir s’étendre au travers du paysage numérique, ce qui nécessite intégration et extensibilité.

Talend ne peut qu’adhérer à cette vision. Par principe, au sein de notre plate-forme Talend Data Fabric, la qualité des données est un élément fondateur qui se décline au travers de toutes nos applications : préparation des données en libre-service, intégration de données et applicative, gestion des méta données et catalogue de données.

Vous pouvez télécharger ici le Gartner Magic Quadrant 2020 pour les solutions de qualité des données.

4 axes d’innovation pour augmenter la maîtrise de la qualité des données

L’étude passe également au peigne fin les innovations technologiques du marché les plus impactantes. Passons en revue ces ingrédients clés (en complément de l’intégration et de l’extensibilité citées précédemment) tout en analysant comment nous les abordons chez Talend.

1. Ubiquité : une approche horizontale, plutôt que verticale, sur les données

Nous considérons la qualité de données comme un principe fondateur de sa plate-forme de gestion de données plutôt que comme une discipline distincte.

L’information est comme une chaine de valeur de bout en bout. Et, la qualité des données peut être découverte, supervisée, corrigée au fil de l’eau, à chaque étape de la vie d’un pipeline de données. C’est ainsi que les clients peuvent délivrer des données de confiance, tout au long du cycle de vie de leurs données.

2. Simplicité : démocratiser la qualité des données grâce à des applications simples et collaboratives

La qualité c’est l’affaire de tous. Et dès lors, ce que l’on attend d’une solution de qualité des données, c’est qu’elle engage chaque participant potentiel et leur facilite le travail. Il faut plus de simplicité, d’intelligence et d’automatisation pour transformer le chaos croissant des données en ressources précieuses et réutilisables.

Dès notre arrivée dans ce Gartner Magic Quadrant en 2011 en qualité de « visionary », nous avons misé sur la démocratisation de la qualité de données. À l’époque, c’était en adoptant le modèle open source pour cibler une audience plus large de développeurs, puis, en 2016, en permettant aux profils non techniques de maîtriser la qualité de leurs données en toute autonomie via notre outil de préparation de données en libre-service. Aujourd’hui, avec Talend Data Fabric, nous proposons une plate-forme unifiée et collaborative dans le cloud capable de rassembler tous les acteurs de l’entreprise pour découvrir, partager, et exploiter toutes les données à leur plein potentiel.

3. Automatiser : quand la qualité de données rencontre l’intelligence artificielle

Optimiser la qualité des données grâce à l’intelligence artificielle et le machine learning est le nerf de la guerre.

« D’ici 2022, 60 % des organisations mettront à profit l’apprentissage supervisé pour améliorer la qualité des données et réduire les tâches manuelles y afférant », prédit Gartner dans son Magic Quadrant.

C’est dans cette perspective qu’il nous semble essentiel de favoriser l’introduction de nouvelles fonctionnalités ayant recours à l’apprentissage automatique. La dernière en date est le Magic Fill qui accélère la préparation des données et la rend accessible à tous pour traiter leurs données plus rapidement et avec plus de précision. Une autre évolution est l’intelligence artificielle explicable, qui permet aux collaborateurs de reprendre le contrôle sur des décisions automatisées par des algorithmes.

4. Collaboration : capturer l’expertise humaine pour plus de confiance dans les données

L’automatisation n’est pas une fin en soi. Le succès de la qualité des données provient souvent d’un travail d’équipe, de technologies et de bonnes pratiques qui s’alignent ensemble pour créer un impact. Les collaborateurs doivent conserver le contrôle, et l’expertise humaine doit pouvoir être capturée et orchestrée au travers la chaîne de données. Des outils permettent aux organisations ‘organiser tout le processus opérationnel de validation et de remédiation de la donnée dès/tant qu’il nécessite des interventions humaines.

Les fonctions de data stewardship, offrent une forte valeur ajoutée : institutionnaliser un cercle vertueux avec leurs données en mettant les collaborateurs au centre du dispositif.

Les données au service de la stratégie des entreprises : cas d’usage

Maintenant que le Cloud permet un déploiement immédiat des innovations, nous les voyons se mettre immédiatement au service de la transformation numérique des entreprises.

Prenons l’exemple de SSQ Assurance, l’une des plus importantes institutions financières canadiennes avec plus de 3 millions de clients et 8 milliards d’euros d’actifs. Le groupe québécois propose de l’assurance collective, auto, habitation, vie, voyage, santé, crédit et également des produits d’épargne. Avec autant d’offres, l’entreprise avait besoin d’unifier sa vision client et de personnaliser les expériences. Elle lance alors une initiative visant non seulement à constituer cette vision client plus globale mais aussi à moderniser son infrastructure IT dans le cloud pour plus d’analytique et pour hausser les standards en termes de confidentialité et protection de l’information.

Au cœur de cette plate-forme complète d’intégration de données, la gouvernance et la qualité des données jouent un rôle critique. Nous avons réussi à mettre en place et automatiser une trentaine d’arbres de décision et une soixantaine de règles de matching pour établir leur « Golden Record ».

Le résultat : le développement d’un processus complet avec des Data Stewards en relais de l’algorithme que l’on a développé.

Une fois réconciliées, les données sont déversées dans le Data Warehouse Snowflake, sur Microsoft Azure.

Depuis, SSQ Assurance dispose d’un portail client Web unifié, avec un seul identifiant/mot de passe pour chaque client. La vue des contrats est consolidée en un seul endroit. Les opérations des clients s’inscrivent automatiquement sur le portail et les centres d’appels bénéficient d’informations plus complètes. Le marketing peut désormais personnaliser ses campagnes en utilisant les données consolidées pour faire tourner des modèles prédictifs. Sur des actions de reconquêtes de clients, SSQ Assurance a triplé ses taux de conversion.

Pour en savoir plus sur le retour d’expérience SSQ, vous pouvez accéder au cas client complet ou bien suivre ce webinar.

Déchiffrer ses données et se les approprier : un enjeu pour les entreprises

Tout le monde devrait pouvoir déchiffrer leurs données, se les approprier, et les améliorer au fil du temps

Gartner prédit ainsi que « d’ici 2022, 70 % des organisations suivront rigoureusement les niveaux de qualité des données, augmentant ainsi la qualité des données de 60% tout en réduisant significativement les risques et les coûts opérationnels ».

À ce titre, l’ADN open source, nous a incité à mettre le data profiling entre toutes les mains. Désormais, une population encore plus large cherche à comprendre les données, à les approuver, les commenter, les noter et les améliorer.

C’est tout l’enjeu du Talend Trust Score que nous avons lancé. Objectif : attribuer systématiquement à toute source de données un score de confiance pour permettre à quiconque envisage de l’utiliser de répondre instantanément à la question suivante « ce jeu de données est-il digne de confiance ? ».

Et ce n’est que le début de l’histoire. Pensez au Nutriscore et à des applications telles que Yuka pour les produits de grande consommation. Ces outils se sont imposés chez les consommateurs pour guider leurs décisions d’achat. Désormais, ils influencent les producteurs de produits de grande consommation pour améliorer leurs produits. Les données de votre entreprise ne méritent elles pas un tel dispositif ?

espace

Sources Gartner :

Gartner, Magic Quadrant for Data Quality Solutions, Melody Chien, Ankush Jain, 27 July 2020.

Gartner, Survey Analysis: Data Management Struggles to Balance Innovation and Control, Melody Chien, Nick Heudecker, 19 March 2020.

Gartner, Build a Data Quality Operating Model to Drive Data Quality Assurance, Melody Chien, Saul Judah, Ankush Jain, 29 January 2020.

Gartner, Magic Quadrant for Data Quality Solutions, “Melody Chien, Ankush Jain”, “27 July 2020”.

Gartner n’endosse aucun fournisseur, produit ou service décrit dans ses publications de recherche et ne conseille pas aux utilisateurs de technologie de ne sélectionner que les fournisseurs ayant obtenu la meilleure note ou autre désignation. Les publications de recherche de Gartner reflètent l’opinion de l’organisme de recherche de Gartner et ne doivent pas être considérées comme des déclarations de fait. Gartner décline toute garantie, expresse ou implicite, concernant cette recherche, y compris toute garantie de qualité marchande ou d’adéquation à un usage particulier.

GARTNER est une marque déposée et une marque de service de Gartner, Inc. et/ou de ses filiales aux États-Unis et dans le monde, et est utilisée ici avec autorisation. Tous droits réservés.

Le graphique présent dans cet article a été publié par Gartner, Inc. dans le cadre d’un document de recherche plus vaste et devrait être évalué dans le contexte de l’ensemble du document. Le document Gartner est disponible sur demande auprès de Talend.

Votre adresse de messagerie est uniquement utilisée par Business & Decision, responsable de traitement, aux fins de traitement de votre demande et d’envoi de toute communication de Business & Decision en relation avec votre demande uniquement. En savoir plus sur la gestion de vos données et vos droits.